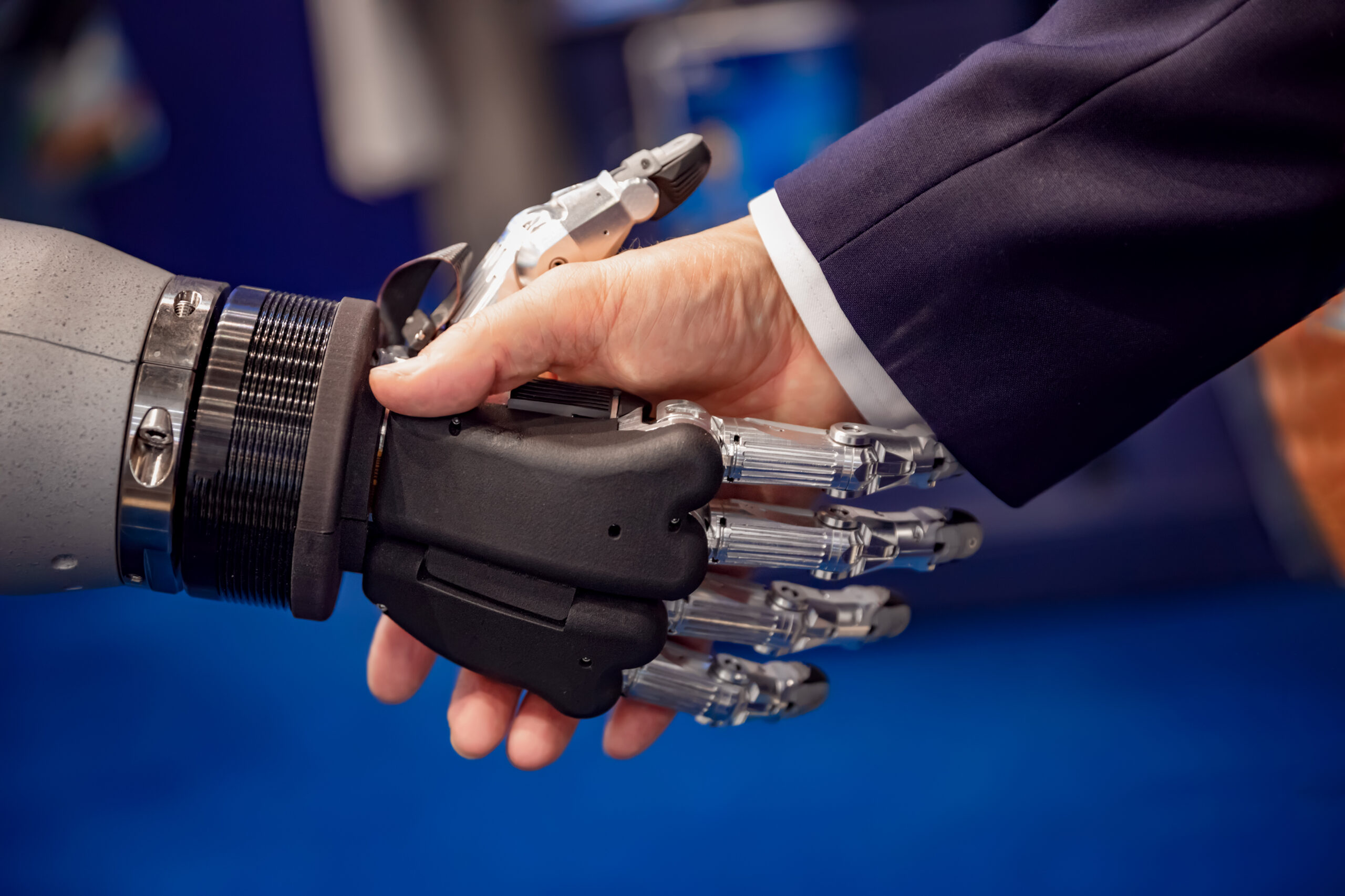

ALGORITHMEN IM ALLTAG: POTENTIALE UND GRENZEN BEI DER MENSCH-MASCHINE-KOOPERATION

Wo können Algorithmen uns zur Hand gehen und welche Probleme können auftreten? Diese Frage wird in diesem Artikel diskutiert.

Zunächst wird darauf eingegangen, um welche Bereiche es dabei gehen soll und welche Kriterien dafür erfüllt sein müssen, weiterhin geht es um die Potenziale von Algorithmen bei Entscheidungs-findung sowie menschliche Probleme bei Entscheidungsfindung. Anschließend werden Probleme und Grenzen von Algorithmen im Vergleich zu Menschen diskutiert. Abschließend kommen Vorschläge zur Mensch-Maschine-Kooperation.

Um welche Bereiche geht es?

Wenn Entscheidungen auf Grund von zufallsverteilten Daten gefällt werden sollen, können Algorithmen (in Form von Machine Learning) eine große Hilfe sein. Am besten funktioniert das, wenn es klare Erfolgskriterien gibt. Ein gutes Beispiel ist das Finden einer medizinischen Diagnose. Auf Grund von Daten aus der Vergangenheit mit Patientendaten (Symptome, Alter, Vorerkrankungen, …) und zugehörigen Diagnosen, kann einem Programm beigebracht werden mögliche Diagnosen für einen konkreten Fall mit zugehörigen Wahrscheinlichkeiten auszugeben. Dies könnte einem Arzt direkt eine Palette von Entscheidungsmöglichkeiten geben. Ein anderes Beispiel wären Investmententscheidungen am Finanzmarkt auf Grund von statistischen Analysedaten. Viele Gebiete bieten Möglichkeiten für maschinelle Unterstützung.

Was können Algorithmen besser?

Zunächst einmal gibt es viele gute Beispiele, wie Menschen fehlerhafte Intuitionen bezüglich Statistik haben. Statistik ist oft kontraintuitiv und verführt schnell zu Trugschlüssen. Maschinen benötigen allerdings keine Intuition für das Einordnen von Informationen. Es werden lediglich trocken Korrelationen erkannt und verarbeitet. Insgesamt sind Algorithmen emotionslos und im wahrsten Sinne des Wortes berechenbar. Menschen sind allerdings leicht beeinflusst von äußeren Faktoren. Ein Beispiel dafür sind die Resultate von Shai Danziger, Jonathan Levav, and Liora Avnaim-Pesso in dem Artikel „Extraneous factors in judicial decisions“ (PNAS April 26, 2011 108 (17) 6889-6892 ), die zeigen, dass die Entscheidungen von Bewährungsrichtern stark davon abhängen, wann sie das letzte Mal etwas gegessen haben. Diese Art der Subjektivität lässt sich mit Algorithmen reduzieren. Selbst, wenn ein Algorithmus bestimmte Fehlentscheidungen häufig trifft, lässt sich das unter Umständen mit einem Patch beheben, während beispielsweise Fehldiagnosen durch Ärzte nicht direkt behoben werden können sondern lange systemische Veränderungen benötigen.

Ein weiterer großer Vorteil ist auch potenziell die schnelle Verfügbarkeit von automatisierten Analysen. In Gebieten, wo ein Arzt unter Umständen schwer zu finden ist, könnte eine Ferndiagnose via Algorithmus wichtige Zeit sparen und Leben retten.

Wo hat der Mensch die Nase vorn?

Der Vorteil bei menschlichen Entscheidungen ist genau, dass er nicht nur auf Grund von Zahlen entscheidet. Oft gehören zu einer Entscheidung viele Fakten, die sich nur schwer in Zahlen ausdrücken lassen. Maschinen haben allerdings Schwierigkeiten mit Dingen, die sich nicht quantifizieren lassen. Dafür ist die Intuition des Menschen ein wichtiger Faktor. Auch ist der Mensch in Gebieten mit wenig oder nur mit unzuverlässigen Daten entschieden im Vorteil; zumindest aktuell sind Menschen besser darin mit wenig Informationen Entscheidungen zu treffen.

Aber gerade bei kritischen Entscheidungen, die Auswirkungen auf Leben oder Tod haben, wollen wir lieber Menschen als Entscheider sehen. Verliert beispielsweise ein Kind auf Grund einer Entscheidung das Leben, ist es uns doch lieber, wenn ein Mensch diese getroffen hat. In solchen Situationen kann bei Deep Learning das Problem auftreten, dass die zugrundeliegenden mathematischen Modelle so kompliziert sind, dass ein Mensch die Entscheidung nicht mehr nachvollziehen kann. Das wäre für Verbliebene eine große emotionale Last.

Abgesehen von Extremfällen ist mangelnde Nachvollziehbarkeit ein Problem bei Deep Learning. Ein Mensch kann seine Entscheidungen erklären, bei einer Maschine ist das aber nicht so ohne weiteres möglich. Außerdem ist die Frage der Verantwortung für Fehlentscheidungen bei Algorithmen sehr schwer zu klären. Bei einem behandelnden Arzt ist dies unmittelbar klar, bei künstlicher Intelligenz hingegen ist das schwer zu klären.

Algorithmen im Alltag: Fazit

Es gibt viele Argumente, die für Algorithmen wie für Menschen sprechen. Modelle, die den Menschen als Entscheidungsträger mit Hilfe von Empfehlungen durch Algorithmen treffen, sind eine Möglichkeit, von Beiden zu profitieren. Wenn die Empfehlungen durch Algorithmen auch noch mit einem Zuverlässigkeitswert ausgestattet sind, könnten diese auch leichter in Entscheidungen miteinbezogen werden. Entscheidet sich der Mensch wider die Empfehlung, könnte er verpflichtet sein ab einem gewissen Zuverlässigkeitswert, Rechenschaft für seine Entscheidung ablegen zu müssen.

Die Frage die wir uns stellen sollten ist nicht nur, was in Zukunft möglich ist, sondern in was für einer Zukunft wir leben wollen.

Bildnachweise für diesen Beitrag:

© cookelma – elements.envato.com

© seventyfourimages – elements.envato.com

© AboutImages – elements.envato.com

Hinterlasse einen Kommentar